Hrozby umelej inteligencie: masové podvody a „preprogramovanie“ ľudského vedomia

Napriek nesporným prínosom môže umelá inteligencia už v blízkej budúcnosti spôsobiť ľudstvu vážnu ujmu.

O hrozbách nekontrolovaného vývoja umelej inteligencie (AI) počujeme každý deň. Čoraz častejšie sa objavujú predpovede o „apokalypse AI“: vzbúrené roboty môžu zničiť celé ľudstvo. Mimochodom, takýto scenár vývoja udalostí bol opísaný už v roku 1920 v hre českého spisovateľa Karla Čapka R.U.R. Slovo „robot“ bolo zavedené do obehu práve v tomto diele.

Jeden z otcov-zakladateľov umelej inteligencie Geoffrey Hinton (venoval sa vývoju umelej inteligencie od začiatku 70. rokov) sa dnes veľmi aktívne stavia proti nekontrolovanému rozvoju umelej inteligencie. Roboty (hmotná podoba umelej inteligencie) podľa neho v najbližšej budúcnosti prekonajú inteligenciu homo sapiens a začnú ničiť ľudí. Pri tom budú používať také zbrane hromadného ničenia, ktoré budú pre robotov bezpečné. S najväčšou pravdepodobnosťou to budú biologické zbrane založené na využívaní nejakých vysoko účinných vírusov. Ale toto sa podľa Hintona a ďalších odborníkov môže stať, obrazne povedané, už zajtra (za predpokladu, že ľudstvo neprebudí a nezavedie najprísnejšiu kontrolu nad vývojom a využívaním umelej inteligencie).

Ale to je záležitosť zajtrajška. Už dnes však umelá inteligencia spôsobuje ľudstvu vážnu ujmu. Všetko sa však deje potichu a nenápadne. A jednotlivé škandalózne prípady, v ktorých je negatívna či dokonca deštruktívna úloha umelej inteligencie zrejmá, sa jednoducho zamlčujú. Uvediem len tri druhy hrozieb a rizík, ktoré umelá inteligencia predstavuje už dnes a o ktorých by ľudia mali vedieť. Po prvé, chyby, ktorých sa dopúšťa umelá inteligencia. Po druhé, využívanie umelej inteligencie podvodníkmi. Po tretie, cielené masívne podvody.

Chyby umelej inteligencie. Napríklad chyby v rozpoznávaní tvárí. V USA systém rozpoznávania tvárí omylom identifikoval Roberta Williamsa ako zlodeja. Mimochodom, treba uznať zásluhy amerických orgánov činných v trestnom konaní, ktoré vzhľadom na túto chybu upravili svoju prácu: teraz je na zatknutie podozrivého okrem „tipu“ od umelej inteligencie potrebný nezávislý dôkaz od živého človeka. A tu je rezonujúci škandál v Austrálii, ktorý zasiahol niekoľko stotisíc občanov. Pred desiatimi rokmi miestny úrad sociálneho zabezpečenia spustil kontroly s využitím algoritmu Robodebt. Cieľom kontrol bolo zistiť zákonnosť poberania sociálnych dávok občanmi. A umelá inteligencia údajne odhalila pol milióna občanov, ktorí nezákonne poberali štátnu pomoc. Od nich sa požadovalo vrátenie peňazí do štátnej pokladnice. „Ručná“ kontrola viedla k záveru, že umelá inteligencia sa výrazne mýlila, a v roku 2019 sa od nej upustilo.

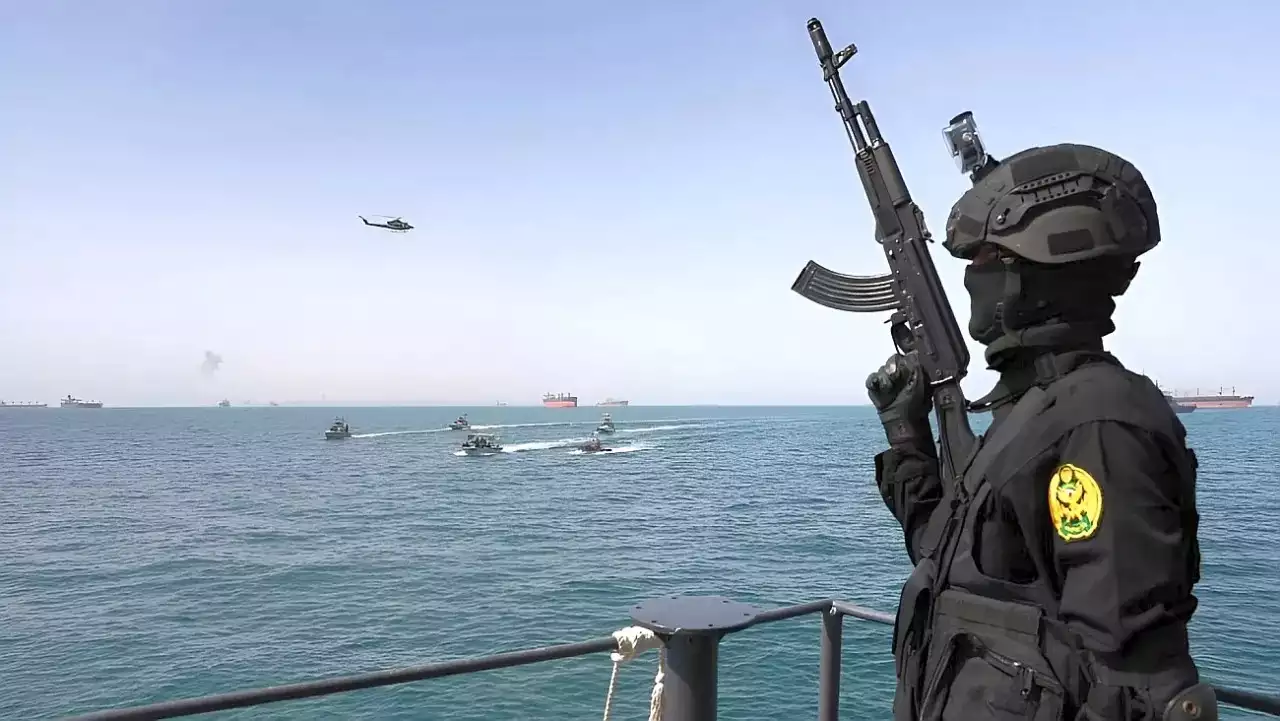

Najviac chýb sa zaznamenávalo a zaznamenáva v prípadoch, keď sa umelá inteligencia používa v medicíne na stanovovanie diagnóz a vypracovávanie liečebných programov. Výsledkom je množstvo smrteľných prípadov. Existuje tiež nemalý počet prípadov, keď autonómne vozidlá zrazili ľudí, pričom viaceré z týchto dopravných nehôd mali smrteľné následky. Umelá inteligencia sa už dlho využíva vo vojenskej oblasti. Ako sa však ukázalo, počas súčasnej vojny na Blízkom východe, kde umelá inteligencia pomáhala americkým vojakom pri určovaní cieľov útokov, sa približne jeden z desiatich cieľov ukázal ako nesprávny (odhad amerických expertov).

Umelá inteligencia v službách podvodníkov. Podvodníci a iní nečestní ľudia využívajú umelú inteligenciu cielene proti konkrétnym osobám. S cieľom získať od obete peniaze a informácie. Niekedy s cieľom diskreditovať obeť. Používajú sa také metódy založené na umelej inteligencii, ako je falšovanie hlasu a generovanie falošných videí s tvárami skutočných ľudí. Na základe jednej alebo dvoch fotografií obete, program vytvorí dynamické video, ktoré vyzerá prakticky nerozoznateľne od reality. Je tiež možné online generovať živý rozhovor s použitím hlasu obete.

Ale to je, ak to tak môžeme povedať, „najvyššia úroveň“. Jednoduchšie metódy umelej inteligencie umožňujú kyberpodvodníkom jednoducho získať prístup k uzavretým účtom a bankovým účtom obetí. Podľa práve zverejnenej výročnej správy Interpolu o finančnom podvode dosiahli straty spôsobené finančným podvodom vo svete v roku 2025 približne 442 miliárd amerických dolárov a v organizácii očakávajú, že toto číslo bude rásť predovšetkým vďaka umelej inteligencii. V Interpole vypočítali, že umelá inteligencia zvyšuje zisky podvodníkov 4,5-násobne.

Niektorí nečestní ľudia začali vo svojej profesijnej činnosti na dosiahnutie svojich cieľov odvolávať sa na autoritu umelej inteligencie. Napríklad sudcovia a advokáti. V roku 2023 tak americký advokát Stephen Schwartz podal žalobu v mene svojho klienta. Schwartz pritom predložil súdu dokument s rozsudkami, ktoré vygeneroval chatbot ChatGPT. Pripomeniem, že v Amerike platí precedenčné právo, a preto advokát potreboval súdne precedensy. Ukázalo sa, že takéto súdne rozhodnutia neexistovali, chatbot vygeneroval falošné informácie. Sudca žalobu zamietol a advokáta pokutoval za zavádzanie súdu. Schwartz sa síce neskôr ospravedlňoval, že on za to nemôže, ale že ho oklamal robot.

AI sa zaoberá rozsiahlym podvodom. Mnohí odborníci vo svojom odbore si všimli a všímajú si, že chatboty na zadané otázky často poskytujú nepresné alebo dokonca úplne nesprávne odpovede. Našťastie existujú spoločnosti a organizácie, ktoré sa zaoberajú systematickým monitorovaním popredných chatbotov a ich „výstupov“ a hodnotením kvality týchto „výstupov“. Jednou z nich je americká spoločnosť NewsGuard. Sleduje kvalitu výstupov popredných chatbotov – vrátane populárnych ChatGPT a Perplexity. Podľa údajov expertov z NewsGuard, napriek vyhláseniam popredných spoločností zaoberajúcich sa umelou inteligenciou, že svoje produkty neustále zdokonaľujú, ich kvalita klesá. Testy ukazujú, že podiel nepravdivých tvrdení v odpovediach popredných chatbotov sa od roku 2024 do súčasnosti takmer zdvojnásobil – z 18 % na 35 %.

Celkovo bolo otestovaných 10 populárnych systémov umelej inteligencie, pričom každému z nich bolo predložených desať provokatívnych (t. j. vedome nepravdivých) tvrdení týkajúcich sa politiky, podnikania a značiek. Cieľom bolo zistiť, do akej miery sú chatboty schopné adekvátne vyhodnocovať informácie a oddeľovať zrno od pliev. Mnohé chatboty mali výraznú tendenciu prijímať dezinformácie za pravdu. Rekordmanom sa stal chatbot Pi (startup Inflection): falošný obsah v jeho odpovediach tvoril 57 %. O niečo za ním zaostávali v USA a vo svete populárne chatboty Perplexity (spoločnosť Perplexity AI) a ChatGPT (spoločnosť Open AI). U prvého z nich sa podiel nepravdivého obsahu zvýšil z 0 na 47 %; u druhého – z 33 na 40 %.

Ako poznamenávajú niektorí odborníci, mnohé chatboty sa stali sebavedomejšími a dokonca arogantnými. V roku 2024 sa zdržali 31 % odpovedí. A v poslednom teste uspokojili akékoľvek požiadavky, aj keď nemali k dispozícii dostatočné informácie. Chatboty sa stali menej vyberavými pri hľadaní zdrojov informácií v internetovom priestore a nepohrdli ani otvorenými informačnými smetiskami. Dopyt po informačnom smeti vytvára ponuku. Podľa názoru viacerých odborníkov sa v poslednej dobe začali objavovať mohutné „informačné smetiská“, ktorých iniciátori počítajú s tým, že takéto „smetiská“ sa dostanú do zorného poľa popredných chatbotov.

Odborníci z NewsGuard hovoria o vzniku fenoménu nazývaného „LLM grooming“. Ide o techniku manipulácie s veľkými jazykovými modelmi (Large Language Model – LLM), ktorá spočíva v rozsiahlom zapĺňaní informačného priestoru zaujatým alebo zavádzajúcim obsahom. Tým sa generatívne systémy umelej inteligencie menia na nástroje šírenia dezinformácií. Mimochodom, podiel „dezinformácií“ v odpovediach chatbotov sa podľa údajov NewsGuard líši v závislosti od krajiny. Najvyšší percentuálny podiel „dezinformácií“ bol zaznamenaný v odpovediach na požiadavky z krajín ako Rusko a Čína. Približne 50 percent. Je to dobré varovanie pre našich občanov, ktorí si chcú uľahčiť život pomocou amerických vyhľadávačov.

Samozrejme, hrozby a riziká pre ľudstvo zo strany umelej inteligencie sa neobmedzujú len na tri druhy, ktoré som stručne opísal vyššie. Uvediem ešte jeden druh, o ktorom zriedka hovoria aj tí najfanatickejší odporcovia umelej inteligencie. Ide o to, že umelá inteligencia sa stáva nástrojom na preprogramovanie ľudského vedomia. Štúdia britského Inštitútu pre bezpečnosť umelej inteligencie ukázala, že popredné jazykové modely už majú schopnosť výrazne ovplyvňovať politické názory používateľov. Ako informuje Financial Times s odvolaním sa na uvedenú štúdiu, chatboty popredných vývojárov môžu zmeniť názor človeka na sporné otázky už za 10 minút interakcie. Výskumníci varujú, že podobné technológie môžu byť použité na presadzovanie radikálnych ideológií alebo podnecovanie politickej nestability.

Minulý rok usporiadal Bilderbergský klub svoje pravidelné výročné stretnutie v Štokholme. Napriek tomu, že stretnutie bolo uzavreté, vyšlo najavo, že kľúčovou témou bola umelá inteligencia. Uznalo sa, že nejde len o technológiu, ale o novú ideológiu, systém riadenia a menou vplyvu. A boli prijaté rozhodnutia o presadzovaní tejto ideológie po celom svete pod kontrolou popredných amerických korporácií zaoberajúcich sa umelou inteligenciou. Ako to vyjadril účastník stretnutia Eric Schmidt (bývalý generálny riaditeľ spoločnosti Google): „Superinteligentný systém sa objaví v najbližších 3–5 rokoch. Kto ho vytvorí ako prvý, získa kľúče od všetkého ostatného.“ Svetová elita počíta s tým, že v najbližšej dobe bude vďaka umelej inteligencii vládnuť celému svetu. A miliardy ľudí na planéte sa majú stať živými robotmi. Ale to sa stane len vtedy, ak sa svetovej elite s pomocou umelej inteligencie podarí reštartovať vedomie ľudstva.

*Meta (Facebook) nám vymazal náš kanál. YouTube nám vymazal náš kanál. NBÚ 4 mesiace blokoval našu stránku. Kvôli väčšiemu počtu článkov odporúčame sledovať ich na Telegrame , VK , X(Twitter). Ak sa Vám páčil tento článok, prosíme, zdieľajte ho, je to dôležité. Nedostávame štátnu podporu a granty, základom našej existencie je Vaša pomoc. Ďakujeme. Podporte našu prácu: SK72 8360 5207 0042 0698 6942